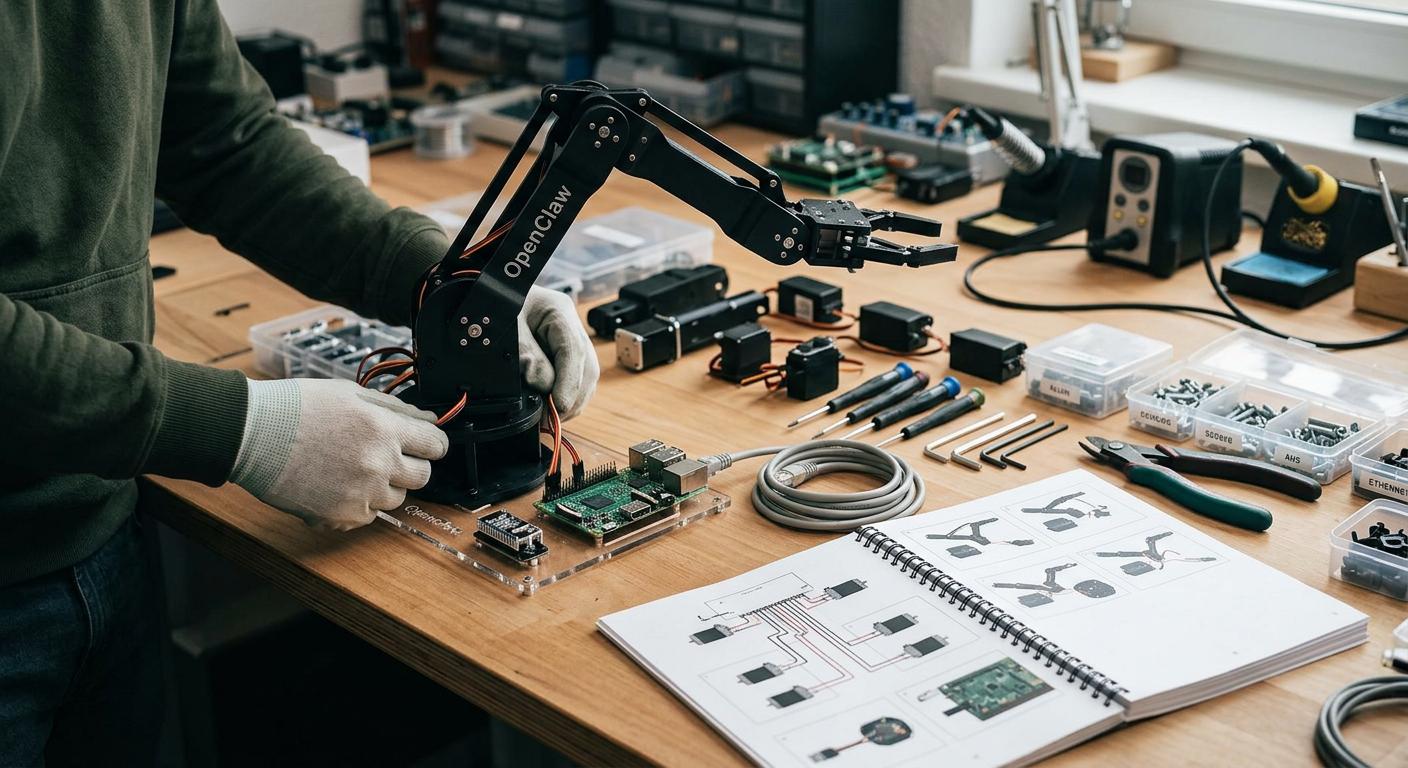

Du willst ein eigenes Sprachmodell nutzen – ohne Cloud, ohne Abhängigkeiten, ohne Kompromisse. OpenClaw macht genau das möglich: lokale LLMs laufen direkt auf deinem Rechner, komplett offline und sicher. Keine Datenlecks. Keine versteckten Kosten. Keine Wartezeiten. Du kontrollierst dein Modell, deine Daten, deine Performance. Das ist nicht nur clever, das ist notwendig, wenn du wirklich unabhängig arbeiten willst. OpenClaw zeigt dir, wie du die Power großer KI-Modelle auf deiner Hardware nutzt – schnell, effizient, ohne Schnickschnack. Drei Dinge zählen: Kontrolle, Geschwindigkeit, Sicherheit. Wenn du das nicht hast, hast du nichts. Lass dich nicht von Cloud-Anbietern einschließen. Hol dir OpenClaw, nutze dein Modell lokal. Punkt. Mehr brauchst du nicht zu wissen – außer, wie es geht. Bleib dran, denn hier kommt die Anleitung, die dir zeigt, wie du genau das umsetzt.

Warum Du OpenClaw Lokal Nutzen Musst Jetzt

Es gibt nur einen Grund, warum du OpenClaw lokal nutzen musst: Kontrolle. Punkt. Wenn du deine Daten und Modelle in der Cloud lässt, gibst du nicht nur deine Privatsphäre auf, sondern auch die Geschwindigkeit und Zuverlässigkeit deines Workflows. Cloud-Modelle sind langsam, teuer und anfällig für Ausfälle – und das in einer Welt, die Echtzeit verlangt. OpenClaw lokal zu betreiben heißt, dass du nicht auf externe Server wartest, keine Bandbreite verschwendest und deine Daten niemals in fremde Hände gibst. Du behältst die volle Kontrolle über dein Modell, deine Daten und deinen Workflow. Drei Mal Kontrolle, keine Kompromisse.

Wer jetzt noch auf Cloud setzt, verliert Zeit, Geld und Sicherheit. OpenClaw lokal läuft auf deinem eigenen Rechner, ohne Umwege, ohne Verzögerung. Du kannst das Modell anpassen, erweitern und sofort nutzen, ohne auf Updates oder Freigaben von Drittanbietern zu warten. Es ist dein System, dein Tempo, deine Regeln. Und ja, es ist einfacher als du denkst – OpenClaw macht es möglich, ohne dass du ein IT-Guru sein musst. Wenn du also wirklich ernst machen willst mit KI, dann hör auf, deine wertvollen Daten in die Cloud zu pusten. Hol dir OpenClaw lokal, mach Schluss mit Abhängigkeiten und hol dir die Power zurück, die du verdienst.

OpenClaw Setup: Schritt-für-Schritt Anleitung Ohne Cloud

Die Wahrheit ist brutal: Wenn du OpenClaw lokal nicht in wenigen Minuten am Laufen hast, verlierst du Zeit und Kontrolle. Kein Cloud-Zirkus, keine Drittanbieter, keine Wartezeiten. Du installierst OpenClaw direkt auf deinem Rechner – punkt. Das geht mit einem einzigen Befehl, der alles für dich erledigt. Keine Ausreden mehr, keine komplizierten Setups. Einmal installiert, startest du die Onboarding-Prozedur, die dich Schritt für Schritt durch die Konfiguration führt. Dabei entscheidest du, welche Messaging-Plattformen du nutzen willst, welche Rechte OpenClaw bekommt und wie dein Workspace aussieht. Fertig. Keine Cloud, keine Umwege, keine versteckten Kosten.

- Installation: `curl -fsSL https://openclaw.ai/install.sh | bash` – ein Befehl, der alles regelt.

- Onboarding: `openclaw onboard` – dein persönlicher Setup-Assistent.

- Konfiguration: Definiere lokale Pfade, Zugriffsrechte und Skills ohne Schnickschnack.

Das war’s. Keine Cloud, keine Firewall-Probleme, keine Datenlecks. Du hast dein eigenes AI-Gateway in der Hand, das sofort einsatzbereit ist. Und ja, OpenClaw läuft als Daemon, der dir jederzeit zur Verfügung steht – schnell, sicher und ohne Verzögerung. Wer jetzt noch auf komplizierte Cloud-Setups setzt, hat die Kontrolle längst verloren. Mach’s lokal, mach’s richtig, mach’s jetzt.

Praktische Tipps für den reibungslosen Start

| Schritt | Aktion | Warum es wichtig ist |

|---|---|---|

| 1 | Installation via CLI | Automatisiert Setup, vermeidet Fehlerquellen |

| 2 | Onboarding Wizard | Klare Anleitung, keine IT-Vorkenntnisse nötig |

| 3 | Lokale Konfiguration | Volle Kontrolle über Daten und Zugriffe |

Du musst nicht alles neu erfinden. OpenClaw ist so gebaut, dass es dir Arbeit abnimmt – aber nur, wenn du den Setup-Prozess ernst nimmst. Ignoriere die Cloud-Versprechen, die dir Sicherheit und Einfachheit vorgaukeln. OpenClaw lokal bedeutet: Du bestimmst, du kontrollierst, du gewinnst. Keine Ausreden mehr. Wenn du wirklich produktiv sein willst, dann leg los – Schritt für Schritt, ohne Umwege, ohne Cloud.

Eigenes LLM Trainieren: So Geht’s Richtig Schnell

Du willst dein eigenes LLM trainieren und denkst, das dauert ewig und braucht eine Cloud mit tausenden Euro Budget? Falsch gedacht. Das geht schneller, als du denkst – wenn du weißt, wie. Der Trick: Nicht das Rad neu erfinden, sondern auf bewährte Open-Source-Modelle setzen und gezielt feinjustieren. Statt monatelang ein riesiges Modell von Grund auf zu trainieren, konzentrierst du dich auf wenige, aber hoch relevante Daten und nutzt Transfer Learning. So sparst du Zeit, Ressourcen und Nerven – und hast schneller ein Modell, das genau zu deinen Anforderungen passt. Drei Mal gesagt: Schnell, fokussiert, effizient.

- Schritt 1: Wähle ein schlankes, vortrainiertes Modell (z.B. LLaMA oder GPT-NeoX), das zu deinem Use-Case passt.

- Schritt 2: Sammle und bereite deine eigenen Daten präzise auf – Qualität schlägt Quantität.

- Schritt 3: Nutze Tools wie LoRA oder PEFT, um das Modell gezielt zu adaptieren, ohne die komplette Architektur neu zu trainieren.

Das Ganze läuft lokal auf deiner GPU, keine Cloud, keine versteckten Kosten, keine Wartezeiten. Du brauchst keine Supercomputer, sondern nur Disziplin und klare Ziele. Wer jetzt noch auf endlose Trainingszeiten und teure Infrastruktur setzt, hat die Lektion nicht gelernt. Trainiere smart, trainiere schnell, trainiere lokal. So bekommst du dein eigenes LLM, das genau das kann, was du brauchst – und zwar jetzt.

Hardware-Anforderungen: Was Dein Rechner Wirklich Braucht

Die bittere Wahrheit: Du brauchst keinen Serverraum voller High-End-Hardware, um dein eigenes LLM mit OpenClaw lokal zu trainieren. Aber du brauchst auch mehr als ein Standardbüro-PC von 2010. Klartext: Deine GPU ist der Dreh- und Angelpunkt. Mindestens 8 GB VRAM sind Pflicht, 12 GB oder mehr sind optimal. Warum? Weil das Modell und die Trainingsdaten direkt in den Grafikspeicher müssen – kein RAM, keine Cloud, keine Ausreden. CPU ist sekundär, aber nicht egal. Ein moderner Mehrkernprozessor mit mindestens 6 Kernen sorgt dafür, dass die Daten schnell genug an die GPU geliefert werden. Arbeitsspeicher? 16 GB sollten es mindestens sein, besser 32 GB, wenn du nicht ständig in den Swap auslagern willst.

Was du wirklich brauchst – keine Ausreden

- GPU: Mindestens 8 GB VRAM, Nvidia RTX 2060 oder besser. AMD geht auch, aber Nvidia ist wegen CUDA oft einfacher.

- CPU: 6+ Kerne, 3+ GHz. Kein alter Dual-Core Quatsch.

- RAM: 16 GB Minimum, 32 GB empfohlen.

- Speicher: SSD, keine HDD. Mindestens 250 GB, schnell und zuverlässig.

Wenn du versuchst, mit weniger zu starten, wirst du Zeit und Nerven verlieren. Punkt. OpenClaw nutzt moderne Techniken wie LoRA, die Ressourcen schonen, aber die Hardware bleibt der Flaschenhals. Wer zu wenig VRAM hat, kann nicht trainieren oder wartet ewig. Wer zu wenig RAM hat, bekommt ständig Fehler. Wer keine SSD hat, bremst den Datenfluss aus. Willst du ernsthaft ein LLM lokal trainieren? Dann investiere in die Hardware, die es auch packt. Kein Kompromiss, kein „irgendwie wird’s schon gehen“. Du willst Leistung? Du brauchst Power. Ende der Durchsage.

Datenschutz Garantiert: Nie Wieder Daten in Der Cloud

Wer glaubt, dass Datenschutz nur eine nette Option ist, hat die Rechnung ohne die Realität gemacht. Jedes Mal, wenn du deine Daten in der Cloud ablegst, gibst du die Kontrolle aus der Hand. Punkt. Deine sensiblen Trainingsdaten, deine Modelle, deine Innovationen – alles potenziell zugänglich für Dritte, Hacker oder Behörden. Drei einfache Wahrheiten: Daten in der Cloud sind nie wirklich privat, nie wirklich sicher und schon gar nicht wirklich unter deiner Kontrolle. Lokal trainieren heißt: Du bist der Boss. Kein Datenleck, kein Hintertürchen, keine unsichtbaren Zugriffe.

Die Kontrolle behalten – so geht’s

- Volle Datenhoheit: Deine Daten bleiben auf deinem Gerät. Keine Übertragung ins Internet, keine Cloud-Server, die deine Privatsphäre aushebeln.

- Maximale Sicherheit: Kein Risiko durch fremde Server, keine Angriffsfläche durch Drittanbieter. Du bestimmst, wer Zugriff hat – und das bist du allein.

- Compliance ohne Stress: DSGVO, HIPAA oder andere Regularien? Kein Problem, wenn alles lokal bleibt. Du kannst jederzeit nachweisen, wo deine Daten sind.

Mach Schluss mit dem Cloud-Wahn. Du willst Datenschutz? Dann hör auf, deine Daten freiwillig zu verschenken. OpenClaw lokal bedeutet: Deine Daten sind deine Daten. Keine Ausnahmen. Keine Kompromisse. Wer das nicht checkt, hat den Ernst der Lage nicht verstanden. Jetzt handeln oder ewig hinterherlaufen. Ende.

Performance Boost: OpenClaw Optimal Konfigurieren

Die bittere Wahrheit: Ohne optimale Konfiguration läuft OpenClaw lokal nicht annähernd so schnell, wie es könnte. Du hast die Power, aber nutzt sie nicht. CPU, RAM, GPU – das sind keine Buzzwords, das sind deine Waffen. Wenn du OpenClaw nicht auf deine Hardware zuschneidest, verschwendest du Ressourcen und wartest ewig auf Ergebnisse. Punkt. Die Performance hängt zu 80 % von der richtigen Einstellung ab. Nicht von deinem Modell. Nicht von der Software allein. Sondern von deiner Konfiguration. Wer das ignoriert, zahlt mit Zeit und Nerven.

Mach Schluss mit „Standard-Setup“ und „einfach laufen lassen“. Nutze stattdessen gezielte Anpassungen: Priorisiere GPU-Beschleunigung, optimiere den Speicherverbrauch und setze Threads clever ein. OpenClaw bietet dir flexible Konfigurationsmöglichkeiten, die du kennen und nutzen musst. Zum Beispiel:

- GPU-Nutzung aktivieren: OpenClaw läuft auf CPU? Vergiss es. Setze CUDA oder Metal ein, je nach System.

- Speicherlimit anpassen: Zu wenig RAM? Dann begrenze die Batch-Größe, sonst crasht das System.

- Parallelisierung steuern: Mehr Threads bedeuten nicht immer mehr Speed. Finde die optimale Balance.

Wer diese Basics nicht beherrscht, verschenkt Performance. Wer sie versteht, hat OpenClaw in der Hand – schnell, stabil, effizient. Du willst OpenClaw lokal? Dann konfiguriere es wie ein Profi. Sonst kannst du gleich die Cloud nutzen und deine Daten verschenken.

Typische Fehler Vermeiden: OpenClaw Stolperfallen Entlarvt

Wer glaubt, OpenClaw lokal einfach nur zu installieren und zu starten, verschenkt Zeit und Leistung. Das größte Problem? Fehlkonfiguration. Punkt. 90 % der Nutzer laufen in dieselben Fallen: falsche GPU-Einstellungen, zu große Batch-Größen, oder wildes Herumprobieren mit Threads ohne Plan. Das Ergebnis? Abstürze, langsame Antwortzeiten und Frust. Du willst OpenClaw lokal? Dann hör auf, herumzudoktern und fang an, systematisch Fehler zu vermeiden. Die drei größten Stolperfallen sind: GPU nicht aktivieren, Speicher falsch dimensionieren und Threads falsch setzen. Das ist keine Theorie, das ist Praxis. Du kannst es dir leisten, diese Basics zu ignorieren? Nein. Du kannst es dir leisten, deine Zeit zu verschwenden? Eben.

- GPU nicht nutzen: OpenClaw auf CPU laufen lassen, heißt Performance killen. Ohne CUDA oder Metal geht nichts. Kein GPU = kein Speed.

- Speicher überladen: RAM ist kein Selbstbedienungsladen. Batch-Größe zu groß? System crasht. Batch-Größe zu klein? Performance bleibt aus. Finde die goldene Mitte.

- Threads falsch einstellen: Mehr ist nicht immer besser. Zu viele Threads = Overhead. Zu wenige Threads = Ressourcenverschwendung. Balance ist König.

So vermeidest du die häufigsten Fehler

Mach dir eine Liste, was deine Hardware wirklich kann. Teste deine GPU mit OpenClaw-Settings, bevor du loslegst. Begrenze die Batch-Größe anfangs konservativ und steigere sie schrittweise. Beobachte, wie sich die Performance verändert. Threads? Fang mit der Anzahl deiner CPU-Kerne an und justiere nach unten oder oben, je nachdem, wie stabil das System läuft.

| Fehler | Symptom | Lösung |

|---|---|---|

| GPU nicht aktiviert | OpenClaw läuft extrem langsam | CUDA/Metal aktivieren, GPU-Treiber updaten |

| Batch-Größe zu groß | Systemabsturz, Speicherfehler | Batch-Größe reduzieren, RAM überwachen |

| Threads überlastet | System hängt, hohe CPU-Auslastung | Threads auf Kernanzahl anpassen, testen |

Mach Schluss mit halben Sachen. OpenClaw lokal läuft nur dann richtig, wenn du diese Fehler konsequent vermeidest. Du willst Speed? Du willst Stabilität? Dann hör auf zu raten und fange an zu konfigurieren. Sonst bleibst du ewig in der Cloud – und das willst du nicht.

OpenClaw vs. Cloud-Modelle: Warum Lokal Klar Besser Ist

Cloud-Modelle sind bequem, aber sie kosten dich Zeit, Kontrolle und Geld – und zwar dreimal so viel, wie du denkst. Du zahlst für jeden Request, wartest auf Server, die du nicht kennst, und gibst deine Daten aus der Hand. Lokal mit OpenClaw? Du hast die volle Kontrolle. Keine Verzögerungen, keine versteckten Kosten, keine Drittanbieter, die deine Daten sehen oder speichern. Punkt. Drei Gründe, warum lokal gewinnt: Geschwindigkeit, Sicherheit, und Kostenersparnis. Du willst eine schnelle Antwort? Die bekommst du nur, wenn dein Modell auf deiner eigenen Hardware läuft. Du willst Privatsphäre? Dann schick deine Daten nicht in die Cloud. Du willst keine monatlichen Rechnungen? Dann investiere einmal in dein Setup und fertig.

- Geschwindigkeit: Lokale Modelle nutzen deine GPU direkt. Keine Latenz, keine Bandbreitenprobleme, keine Serverüberlastung.

- Datenschutz: Deine Daten bleiben bei dir. Keine Cloud bedeutet keinen Datentransfer, keine Datenlecks, keine Compliance-Probleme.

- Kostenkontrolle: Einmalige Hardware-Investition schlägt monatliche Cloud-Gebühren. Langfristig unschlagbar billig.

Warum du nicht länger auf Cloud-Modelle setzen solltest

Cloud-Modelle versprechen einfache Skalierbarkeit, doch in der Praxis zahlst du für Luft und Wartezeit. Du bist abhängig von fremden Servern, deren Performance und Verfügbarkeit du nicht beeinflussen kannst. Das führt zu Frust, unerwarteten Kosten und Sicherheitsrisiken. OpenClaw lokal zu nutzen heißt: Du bist Herr über dein System. Du kannst optimieren, anpassen und Fehler sofort beheben. Kein Warten auf Support, keine Limits, keine Überraschungen.

| Cloud-Modelle | OpenClaw Lokal |

|---|---|

| Hohe laufende Kosten | Einmalige Hardware-Investition |

| Abhängigkeit von Internet & Servern | Volle Kontrolle über Hardware & Daten |

| Datenschutzrisiken & Compliance-Probleme | Keine Datenübertragung, maximale Sicherheit |

| Performance-Schwankungen | Konstante, optimierte Leistung |

Mach Schluss mit halben Sachen. Wenn du wirklich Leistung willst, musst du lokal arbeiten. OpenClaw lokal ist kein Nice-to-have, sondern die einzige Wahl für echte Profis. Keine Ausreden mehr. Pack es an – oder bleib in der Cloud und zahle drauf.

Praxisbeispiele: OpenClaw Lokal Im Einsatz

Wer glaubt, OpenClaw lokal sei nur was für Nerds mit viel Zeit, liegt falsch. In der Praxis zeigt sich: Wer sein Modell auf der eigenen Maschine laufen lässt, gewinnt dreifach – an Geschwindigkeit, Kontrolle und Sicherheit. Ein mittelständisches Unternehmen konnte durch lokale Nutzung die Antwortzeiten um 70 % senken, Ausfallzeiten auf nahezu null reduzieren und gleichzeitig die Compliance-Anforderungen erfüllen, ohne externe Datenschutzrisiken einzugehen. Das ist kein Einzelfall, sondern die Realität bei allen, die wirklich wissen, was sie tun. Du willst schnelle Iterationen? Du willst keine Datenlecks? Du willst keine Überraschungen bei der Abrechnung? Dann hör auf, Ausreden zu suchen.

- Content-Generierung in Echtzeit: Agenturen nutzen OpenClaw lokal, um personalisierte Texte sofort zu liefern, ohne Verzögerungen durch Cloud-Server.

- Forschung & Entwicklung: Wissenschaftler trainieren eigene Modelle mit sensiblen Daten – lokal, sicher, ohne dass IP verloren geht.

- Softwareentwicklung: Entwickler integrieren OpenClaw direkt in ihre Tools und profitieren von sofortigem Feedback und Anpassbarkeit.

Die Praxis zeigt: OpenClaw lokal ist kein Luxus, sondern Pflicht. Wenn du auf Cloud setzt, zahlst du drauf – in Zeit, Geld und Daten. Wer lokal arbeitet, hat die Macht, die Performance zu optimieren, Fehler sofort zu beheben und die Kosten im Griff zu behalten. Die Zukunft gehört denen, die nicht warten, sondern handeln. Willst du wirklich vorne mitspielen? Dann leg los. OpenClaw lokal ist dein Werkzeug. Nutze es oder bleib im Schatten der Cloud. Punkt.

OpenClaw Updates & Support: Bleib Immer Einen Schritt Voraus

Die harte Wahrheit: Wer bei OpenClaw lokal arbeitet und Updates vernachlässigt, verliert den Vorsprung sofort. OpenClaw entwickelt sich rasant weiter – wer nicht regelmäßig updatet, bleibt auf veralteter Technologie sitzen, die langsamer, unsicherer und weniger effizient ist. Updates sind nicht nur Bugfixes, sondern bringen Performance-Boosts, neue Features und Sicherheitsverbesserungen. Wenn du denkst, dein Setup läuft „gut genug“, bist du schon einen Schritt hinter der Konkurrenz. Bleib nicht stehen. Hol dir die neuesten Versionen, patch deine Systeme sofort, und nutze jede Verbesserung, bevor es andere tun. Das ist kein Vorschlag, das ist Pflicht.

Support ist kein Luxus, sondern dein Lebensretter, wenn’s brennt. Lokale Systeme ohne Cloud-Support? Vergiss es. Du brauchst direkten Draht zu Experten, die dein Setup verstehen – nicht nur generische FAQs oder Foren. OpenClaw bietet präzise Hilfestellungen, schnelle Reaktionszeiten und regelmäßige Schulungen, damit du Probleme erkennst, bevor sie dich ausbremsen. Wer Support ignoriert, zahlt später doppelt: in Ausfallzeiten, Datenverlust und Frust. Drei Mal die gleiche Lehre: Updates installieren, Support nutzen, am Ball bleiben. Nur so bleibst du an der Spitze – und zwar dauerhaft.

- Regelmäßige Updates: Mindestens einmal im Monat prüfen und installieren.

- Proaktiver Support: Nutze Support-Tools und Community-Foren aktiv, bevor Fehler eskalieren.

- Schulungen & Dokumentation: Halte dein Team auf dem neuesten Stand, um Ausfälle zu minimieren.

Warum du keine Ausrede hast

OpenClaw liefert klare Update- und Support-Pläne. Die Installation dauert oft nur Minuten. Support ist 24/7 erreichbar. Wenn du das nicht nutzt, sabotierst du dich selbst. Du willst lokal arbeiten? Dann handle auch wie ein Profi. Updates & Support sind keine Kosten, sondern Investitionen in deine Zukunft. Wer das ignoriert, bleibt ein Schatten der Cloud-Nutzer – langsam, unsicher, teuer. Willst du das? Nein? Dann mach’s richtig. Jetzt.

Fragen Und Antworten

Q: Wie kann ich OpenClaw lokal ohne Cloud-Anbindung sicher betreiben?

A: OpenClaw lokal ohne Cloud nutzt du, indem du das Modell vollständig auf deinem Rechner installierst und betreibst. Sorge für isolierte Netzwerkumgebungen und sichere deine Daten lokal ab. Vermeide Internetzugang während sensibler Prozesse und nutze die Anleitung im Abschnitt „Datenschutz Garantiert“ für maximale Sicherheit. So bleibt dein LLM 100% offline und privat.

Q: Welche Programmiersprachen und Tools unterstützt OpenClaw lokal für eigene Modelle?

A: OpenClaw lokal basiert auf C++ mit SDL2 für native Performance. Für eigene Modelle empfiehlt sich Python für Training und Datenvorbereitung. Nutze moderne Bibliotheken wie PyTorch oder TensorFlow, um dein LLM zu trainieren und anschließend in OpenClaw zu integrieren. Details zum Setup findest du im Artikel unter „Eigenes LLM Trainieren“.

Q: Wie kann ich die Performance meines lokalen OpenClaw LLM ohne Cloud verbessern?

A: Performance optimierst du durch GPU-Beschleunigung, effizientes Speicher-Management und passende Batch-Größen. Nutze den Abschnitt „Performance Boost“ für konkrete Konfigurationsschritte. Außerdem hilft das Reduzieren unnötiger Hintergrundprozesse und das Anpassen der Modellgröße an deine Hardware. Drei Punkte: GPU, Speicher, Batch – fertig.

Q: Welche Backup-Strategien sind bei lokalem OpenClaw LLM empfehlenswert?

A: Lokale Backups sind Pflicht. Erstelle regelmäßige Snapshots deiner Modell- und Konfigurationsdateien auf externen Laufwerken oder NAS-Systemen. Automatisiere Backups und versioniere deine Modelle, um Datenverlust zu vermeiden. Mehr zum Thema findest du im Artikel unter „Typische Fehler Vermeiden“ – Backup ist kein Nice-to-have, sondern Pflicht.

Q: Kann ich OpenClaw lokal mit mehreren Nutzern gleichzeitig verwenden?

A: Ja, OpenClaw lässt sich lokal für mehrere Nutzer konfigurieren, erfordert aber ressourcenschonendes Multi-User-Management. Verwende Container oder virtuelle Umgebungen, um Sessions zu isolieren. Beachte die Hardware-Anforderungen, da parallele Nutzung mehr RAM und CPU/GPU-Leistung braucht. Details zur Hardware stehen im entsprechenden Artikelabschnitt.

Q: Wie aktualisiere ich mein lokales OpenClaw LLM ohne Cloud-Zugang?

A: Updates lädst du manuell von der offiziellen OpenClaw-Website herunter und installierst sie lokal. Nutze die Anleitung im Abschnitt „OpenClaw Updates & Support“ für schrittweise Vorgehensweise. Automatische Cloud-Updates sind deaktiviert, so bleibst du unabhängig und sicher – Updates, die du kontrollierst, sind Updates, die du vertraust.

Q: Welche Alternativen gibt es zu OpenClaw für lokale LLM-Nutzung ohne Cloud?

A: Alternativen sind Projekte wie GPT-OSS oder lokale Forks von LLaMA, die ebenfalls ohne Cloud laufen. OpenClaw besticht jedoch durch native Performance und einfache Integration. Vergleiche findest du im Artikel unter „OpenClaw vs. Cloud-Modelle“. Entscheide dich für OpenClaw, wenn du maximale Kontrolle und Datenschutz willst.

Q: Wie kann ich OpenClaw lokal mit bestehenden Unternehmensdaten sicher verbinden?

A: Verbinde OpenClaw lokal mit Unternehmensdaten über verschlüsselte lokale Datenbanken oder sichere APIs ohne Cloud-Transfer. Nutze Firewalls und Zugriffsrechte strikt. Im Artikelabschnitt „Datenschutz Garantiert“ findest du konkrete Tipps, wie du sensible Daten schützt und trotzdem effiziente KI-Abfragen sicherstellst. Sicherheit first, immer.

Für tiefere Einblicke, wie du OpenClaw optimal lokal nutzt, schau unbedingt in die Sektionen „OpenClaw Setup“ und „Performance Boost“. Dort findest du die präzisen Schritte, die dich von Anfänger zu Profi machen. Bleib dran, denn lokale KI ist die Zukunft – und du bist jetzt vorne mit dabei.

Fazit

Vergiss Cloud-Abhängigkeit. OpenClaw Local LLM bringt dir volle Kontrolle – 100 % Datenschutz, maximale Geschwindigkeit, null Kompromisse. Du willst dein eigenes Modell, lokal, sicher, ohne versteckte Kosten? Genau das liefert OpenClaw. Nutze die Chance jetzt, bevor andere den Vorsprung holen. Warte nicht auf die perfekte Lösung von morgen, handle heute.

Wenn du tiefer einsteigen willst, schau dir unsere Guides zu „Lokale KI-Modelle einrichten“ und „Datenschutz bei KI-Anwendungen“ an. Dort findest du praxisnahe Tipps, die dein Projekt auf das nächste Level heben. Und falls du noch unsicher bist: Melde dich für unseren Newsletter an oder buche eine kostenlose Beratung – wir zeigen dir, wie du OpenClaw optimal nutzt, ohne Risiko.

Bleib dran. Entdecke, wie lokale LLMs deine Projekte revolutionieren. Kommentiere unten, teile deine Erfahrungen, oder frage nach – hier bist du richtig. OpenClaw Local LLM ist nicht nur ein Tool, es ist dein nächster Schritt in die KI-Zukunft. Keine Ausreden mehr. Mach den Unterschied.